المثالية المفقودة لعملاق التكنولوجيا

حكم قضائي لصالح «ميتا» بمنع موظفة سابقة من نشر فضائح «الفيس بوك»

حصلت شركة ميتا المالكة لموقع التواصل الاجتماعي الفيس بوك على حكم قضائى من المركز الدولي لتسوية النزاعات، بمنع إحدي الموظفات السابقات من نشر كتاب لها يضم بعض فضائح الشركة.

وكانت « سارة وين ويليامز»، عضو فريق الشؤون العالمية لشركة الفيس بوك سابقا، قد أعلنت عن تأليف كتاب يضم بعض فضائح شركة ميتا، وهو ما دعا الشركة إلى اللجوء إلى هيئة التحكيم، بدعوي أن الكتاب يخالف عقد عدم التشهير الذي وقعته الموظفة صاحبة الكتاب، ووافقت المحكمة على طلب ميتا بمنعها من الترويج للكتاب أو الإدلاء بتصريحات تضر بمصالح الشركة.

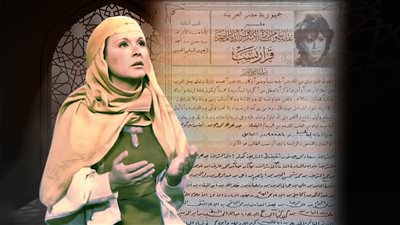

وبحسب الحكم القضائي الصادر لصالح شركة الفيس بوك فإنه يجب على الموظفة السابقة « سارة وين ويليامز»، التراجع عن انتقاداتها السابقة بشأن ميتا أو مسؤوليها التنفيذيين، جاء ذلك بالتزامن مع بدء دار نشر ماكميلان من توزيع نسخ من الكتاب الذى جاء تحت عنوان «أشخاص مهملون.. قصة تحذيرية عن السلطة والجشع والمثالية المفقودة».

وتروي « سارة وين ويليامز»، تجربتها في العمل لدى شركة الفيس بوك قبل أن تغيير اسمها إلى ميتا بين عامي 2011 و2017، ويتضمن وقائع تحرش جنسي من قِبل المدير التنفيذي في الشركة، جويل كابلان، وهو جمهوري بارز وحليف للرئيس دونالد ترامب، وهو الذى تولى رئاسة فريق الشؤون الدولية في ميتا قبل شهور قليلة.

وأشارت إلى أن شركة ميتا، المعروفة آنذاك باسم الفيس بوك قدمت معلومات للأجهزة الأمنية التابعة للحكومة الصينية فى محاولة منها لاسترضاء بكين للعمل فى السوق الصينية، حيث قدم الفيس بوك معلومات على النشطاء وكذلك المحتوي خاصة فى هونج كونج.

دعم الاحتلال الإسرائيلي

وواجهت ميتا وموقعها الفيس بوك انتقادات متكررة بسبب سياساتها المتعلقة بجمع البيانات الشخصية لمليارات المستخدمين، حول العالم حيث حققت من ورائها أرباح خيالية دون الوضع فى الاعتبار سلامة المستخدمين.

كما واجهت انتقادات حادة بسبب اتهامات لـ الفيس بوك بمواءمة سياساته مع أجندة الرئيس الأمريكي دونالد ترامب، حيث أشارت تقارير إلى إشراف مارك زوكربيرج شخصيًا على بعض التوجهات التي تعكس تقاربًا مع أفكار ترامب.

وكانت ذروة التجاوزت خلال العام الماضي عندما طور جيش الاحتلال الإسرائيلي برنامجًا مدعومًا بالذكاء الاصطناعي لاختيار ضحايا تفجيراته، وهي عملية تحتاج تقليديًا إلى التحقق يدويًا حتى يتم التأكد من أن الشخص هو هدف، والذى جاء بالتعاون مع شركة ميتا مالكة تطبيق واتساب..

هذا النظام الذي أطلق عليه اسم «لافندر»، استخدم نحو 37 ألف فلسطيني كأهداف محتملة خلال الأسابيع الأولى من الحرب، بين 7 أكتوبر و24 نوفمبر 2023، وتم استخدامه في ما لا يقل عن 15 ألف جريمة قتل في الهجوم على قطاع غزة الفلسطيني.

وكشفت صحف الأروبية أن نظام لافندر القاتل، اعتمد على مجموعات واتساب، وقال الأيرلندي بول بيجار، صاحب أول مبادرة رقمية لدعم فلسطين، أن لافندر هو نظام ما قبل الجريمة الإسرائيلي، يستخدمون فيه الذكاء الاصطناعي لتخمين من سيقتلون في غزة، ثم يقصفونه عندما يكونون في المنزل، مع أسرهم بأكملها بشكل فاحش.